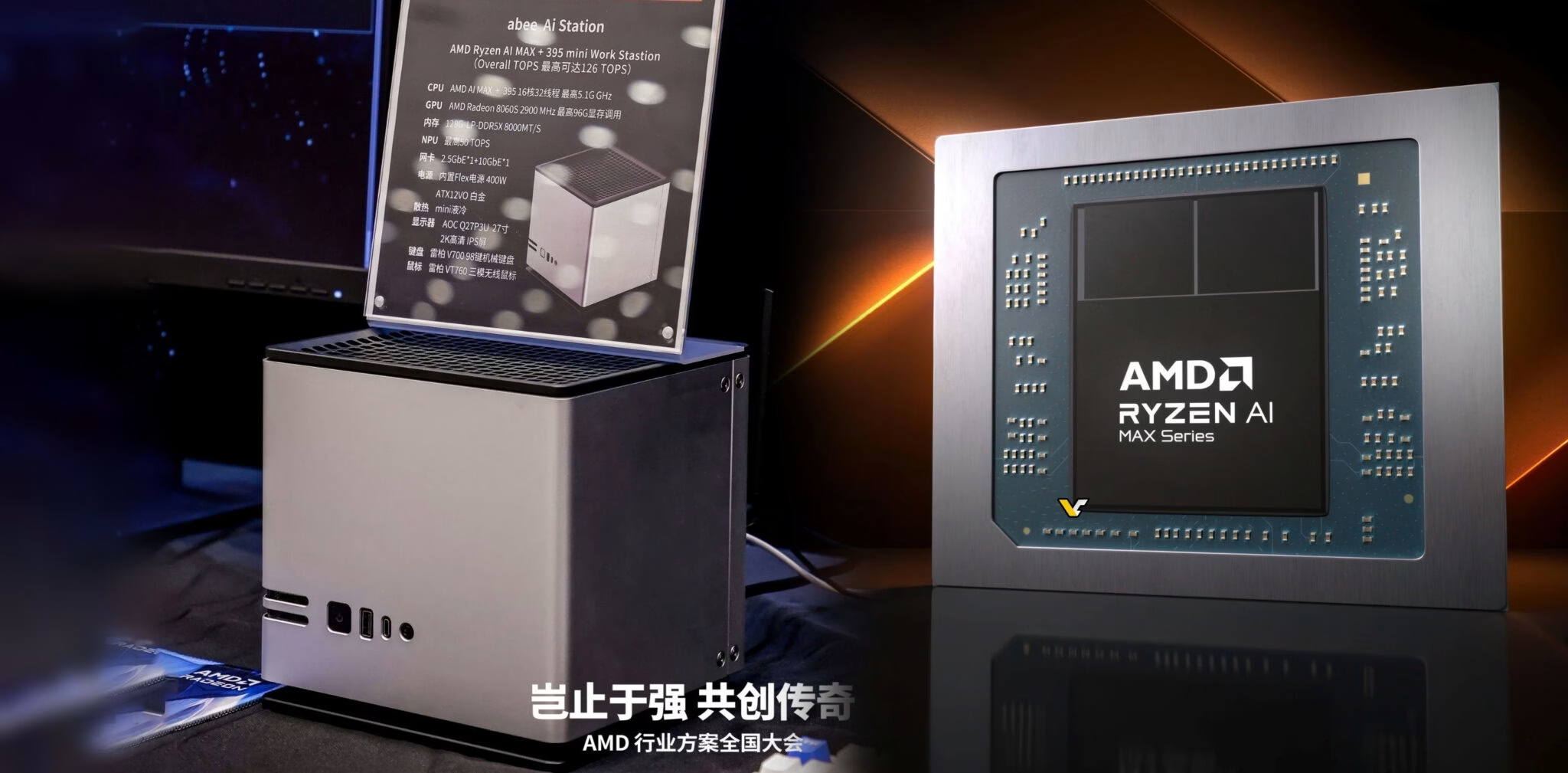

Sự xuất hiện của ABEE AI Station, một hệ thống máy tính nhỏ gọn nhưng đầy uy lực, đang thu hút sự chú ý đáng kể trong giới công nghệ. Được phát triển bởi ABEE, một công ty thuộc WPG Holdings, thiết bị này hứa hẹn định hình lại cách chúng ta tiếp cận các giải pháp trí tuệ nhân tạo (AI) tại chỗ, nhờ vào việc tích hợp bộ xử lý tăng tốc (APU) hàng đầu của AMD – Ryzen AI MAX+ 395. Đây là con chip 16 nhân, tên mã Strix Halo, được thiết kế để mang lại hiệu năng vượt trội cho các tác vụ AI mà không cần đến card đồ họa rời cấp thấp.

Trái Tim AI Mạnh Mẽ: AMD Ryzen AI MAX+ 395

Trung tâm của ABEE AI Station chính là AMD Ryzen AI MAX+ 395, một APU thực sự ấn tượng. Với 16 nhân và 32 luồng, cùng xung nhịp lên đến 5.1 GHz, con chip này không chỉ mạnh mẽ về khả năng xử lý truyền thống mà còn được tối ưu hóa đặc biệt cho AI. Điều này thể hiện rõ qua bộ xử lý thần kinh (NPU) tích hợp, có khả năng đạt tới 50 TOPS (Tera Operations Per Second). Con số này cho thấy tiềm năng đáng kể trong việc chạy các mô hình AI phức tạp trực tiếp trên thiết bị, giảm thiểu độ trễ và tăng cường quyền riêng tư dữ liệu.

Không chỉ dừng lại ở CPU và NPU, APU này còn sở hữu GPU tích hợp AMD Radeon 8060S với xung nhịp 2900 MHz. Đây là một GPU mạnh mẽ, đủ sức gánh vác nhiều tác vụ đồ họa và tính toán mà trước đây thường yêu cầu một card đồ họa rời. Thực tế, nó có thể hỗ trợ phân bổ tới 96GB bộ nhớ hệ thống làm VRAM, một con số cực kỳ lớn cho một GPU tích hợp. Điều này không chỉ giúp tiết kiệm chi phí mà còn làm cho hệ thống trở nên gọn gàng, hiệu quả hơn, loại bỏ nhu cầu về các GPU rời cấp thấp.

Bộ Nhớ Khủng và Khả Năng AI Tại Chỗ

Một trong những điểm nổi bật nhất của ABEE AI Station là dung lượng bộ nhớ. Thiết bị này được trang bị tới 128GB LPDDR5X, chạy ở tốc độ 8000 MT/s. Đây là một lượng RAM khổng lồ cho một hệ thống Mini-PC, đặc biệt khi xét đến việc bộ nhớ này được hàn chết (soldered) và không thể nâng cấp. Tuy nhiên, với 128GB, liệu có ai thực sự cần nâng cấp thêm không? Câu trả lời có lẽ là không.

Lượng bộ nhớ này đóng vai trò cực kỳ quan trọng trong các ứng dụng AI, đặc biệt là cho các tác vụ suy luận (inference) hoặc chạy các mô hình ngôn ngữ lớn (LLM) cục bộ. Nhiều Mini-PC khác trên thị trường thường chỉ cung cấp tối đa 96GB bộ nhớ, trong đó một phần được phân bổ làm VRAM. Việc ABEE AI Station có sẵn 128GB LPDDR5X tốc độ cao mang lại lợi thế đáng kể, cho phép người dùng tải và xử lý các mô hình AI lớn hơn, phức tạp hơn mà không gặp phải tình trạng thiếu hụt tài nguyên. Đây là một bước tiến lớn cho những ai muốn xây dựng một giải pháp AI cá nhân hoặc doanh nghiệp nhỏ mà không cần đầu tư vào các máy chủ đắt đỏ.

Giải Pháp Tản Nhiệt Độc Đáo và Nguồn Điện Tích Hợp

Điều thực sự khiến ABEE AI Station khác biệt so với phần còn lại của thị trường Mini-PC là giải pháp tản nhiệt. Thay vì dựa vào các quạt khí truyền thống, ABEE đã trang bị cho thiết bị này một hệ thống tản nhiệt chất lỏng mini. Hệ thống này bao gồm hai quạt 92mm được gắn ở hai bên, kết nối với một bộ tản nhiệt bên trong, và một bơm được gắn trực tiếp lên APU.

Việc sử dụng tản nhiệt chất lỏng trong một form factor nhỏ gọn như vậy là một minh chứng cho kinh nghiệm dày dặn của ABEE. Công ty này vốn đã có tiếng trong việc phát triển các giải pháp tản nhiệt riêng, cùng với khung máy chủ và bộ nguồn chất lượng cao. Giải pháp này không chỉ giúp duy trì hiệu suất ổn định cho APU Ryzen AI MAX+ 395 khi hoạt động ở cường độ cao, mà còn giảm thiểu tiếng ồn đáng kể so với các hệ thống tản nhiệt khí thông thường.

Một tính năng đáng chú ý khác là bộ nguồn Flex ATX 400W được tích hợp sẵn bên trong. Điều này loại bỏ hoàn toàn nhu cầu về một cục nguồn bên ngoài cồng kềnh, chỉ cần một sợi cáp nguồn tiêu chuẩn là đủ. Nguồn điện này còn đạt chuẩn Platinum, cho thấy hiệu suất chuyển đổi năng lượng rất cao, giúp tiết kiệm điện và giảm nhiệt lượng tỏa ra. Thiết kế này không chỉ làm cho ABEE AI Station gọn gàng hơn mà còn tăng tính thẩm mỹ và tiện lợi khi sử dụng.

Kết Nối Đa Dạng và Ứng Dụng Tiềm Năng

ABEE AI Station không chỉ mạnh mẽ về xử lý mà còn rất linh hoạt trong kết nối. Thiết bị này được trang bị một cổng mạng 2.5GbE và một cổng 10GbE. Các tùy chọn mạng tốc độ cao này là cực kỳ quan trọng cho các ứng dụng AI, nơi việc truyền tải lượng lớn dữ liệu là điều thường xuyên xảy ra. Cổng 10GbE đặc biệt hữu ích cho các môi trường làm việc chuyên nghiệp, nơi cần truy cập nhanh chóng vào các tài nguyên mạng hoặc lưu trữ NAS.

Với cấu hình như vậy, ABEE AI Station có thể được sử dụng trong nhiều kịch bản khác nhau. Nó có thể là một trạm làm việc AI cá nhân mạnh mẽ cho các nhà phát triển, một máy chủ AI cục bộ cho các doanh nghiệp nhỏ, hoặc thậm chí là một phần của hệ thống tính toán biên (edge computing). Khả năng xử lý AI tại chỗ, kết hợp với bộ nhớ lớn và kết nối tốc độ cao, mở ra nhiều cánh cửa cho các ứng dụng từ xử lý ngôn ngữ tự nhiên đến phân tích hình ảnh và video.

Triển Vọng và Vị Thế Trên Thị Trường

ABEE AI Station rõ ràng là một sản phẩm được thiết kế với tầm nhìn xa, hướng đến kỷ nguyên AI đang bùng nổ. Với sự kết hợp giữa APU hàng đầu của AMD, lượng RAM dồi dào, giải pháp tản nhiệt chất lỏng tiên tiến, và bộ nguồn tích hợp, thiết bị này tạo nên một gói giải pháp AI tại chỗ cực kỳ hấp dẫn. Nó không chỉ cung cấp hiệu năng mạnh mẽ mà còn tối ưu hóa về không gian và tiện lợi.

Trong bối cảnh thị trường Mini-PC đang ngày càng cạnh tranh, ABEE AI Station nổi bật như một lựa chọn cao cấp cho những ai cần hiệu năng AI nghiêm túc trong một form factor nhỏ gọn. Liệu nó có thay đổi cuộc chơi? Có thể lắm. Nó chắc chắn sẽ thúc đẩy các nhà sản xuất khác phải đổi mới hơn nữa, mang lại nhiều lựa chọn tốt hơn cho người tiêu dùng trong tương lai. Đây thực sự là một thiết bị đáng để theo dõi.